Comment détecter un texte généré par intelligence artificielle ? Les détecteurs ChatGPT, véritables outils sophistiqués, repoussent les limites de l’analyse linguistique. Grâce à des algorithmes avancés, ils décortiquent chaque détail pour révéler l’origine artificielle d’un contenu. Mais par quels moyens parviennent-ils à distinguer l’authentique du généré ?

Le fonctionnement des détecteurs ChatGPT : principes de base

Un regard approfondi sur les détecteurs ChatGPT et leurs algorithmes

L’analyse des textes générés repose sur des outils capables de scanner chaque mot et chaque structure. Les détecteurs ChatGPT examinent les séquences linguistiques en utilisant des probabilités complexes. Leur objectif : identifier des anomalies qui échappent à l’œil humain. Ces anomalies incluent une syntaxe immaculée, une fluidité suspecte ou des répétitions peu naturelles.

Dans un cadre professionnel, ces outils garantissent la légitimité des contenus critiques. Une entreprise de conseil, par exemple, pourrait s’appuyer sur ces détecteurs pour vérifier que ses rapports stratégiques sont bien rédigés par des experts humains. Cette assurance renforce la confiance des parties prenantes et protège l’intégrité des échanges.

Les algorithmes ne se limitent pas à des observations superficielles. Ils identifient des schémas linguistiques complexes, souvent invisibles pour un lecteur ordinaire. Une interface utilisateur affiche fréquemment des zones surlignées, signalant les éléments suspects pour une meilleure compréhension.

Des modèles complémentaires : générateurs IA et détecteurs

Les modèles générateurs, comme GPT, produisent des textes d’une fluidité impressionnante. Cependant, cette perfection devient un piège lorsque les détecteurs analysent leurs faiblesses. Une relation intrigante émerge entre ces deux technologies, illustrée par leurs interactions constantes.

| Critère | Modèles générateurs IA | Détecteurs ChatGPT |

|---|---|---|

| Fonction | Créer des contenus cohérents | Relever des anomalies stylistiques |

| Applications | Rédaction automatisée variée | Validation de l’authenticité |

| Technologie | Réseaux neuronaux prédictifs | Analyse linguistique avancée |

| Limites | Failles linguistiques | Faux positifs |

Les détecteurs exploitent les failles des générateurs pour affiner leur précision. Cette interaction dynamique repose sur des calculs algorithmiques, mais également sur des bases de données réelles. Ces bases permettent d’identifier des écarts improbables entre les textes humains et ceux générés par IA.

« Ce rapport semble authentique, mais quelque chose cloche. » Ce directeur, en pleine analyse, ressent un doute. Il utilise un détecteur ChatGPT, qui met en évidence des anomalies improbables dans les tournures de phrases. Le verdict tombe : ce document stratégique provenait d’une IA. Une découverte qui évite une erreur coûteuse !

Les critères utilisés par les détecteurs pour analyser un texte IA

La structure et la grammaire en ligne de mire

Les détecteurs utilisent des algorithmes pour analyser la cohérence grammaticale et syntaxique des textes. Souvent, les créations IA présentent une fluidité trompeuse, où chaque phrase s’imbrique sans irrégularité. Cette perfection artificielle attire immédiatement l’attention des outils d’analyse.

Les répétitions excessives, les synonymes inhabituels ou les séquences improbables sont également des indices révélateurs. Ces anomalies, bien que discrètes, deviennent évidentes face aux capacités d’analyse des détecteurs. Ils mettent en surbrillance les zones problématiques pour faciliter l’interprétation.

Les schémas linguistiques et l’analyse probabiliste

Les textes IA révèlent souvent des schémas récurrents, comme une fréquence excessive de certains mots. Les détecteurs comparent ces occurrences avec des bases de données humaines pour identifier les divergences. Une expression trop répétée, par exemple, signale une origine artificielle.

Ce processus repose sur une analyse probabiliste, où chaque mot est examiné dans son contexte. Les détecteurs mesurent les enchaînements improbables et les incohérences statistiques. Ces analyses renforcent leur capacité à différencier un texte authentique d’un contenu généré par IA.

Les principaux outils de détection de texte généré par ChatGPT

Des outils performants pour répondre aux besoins variés

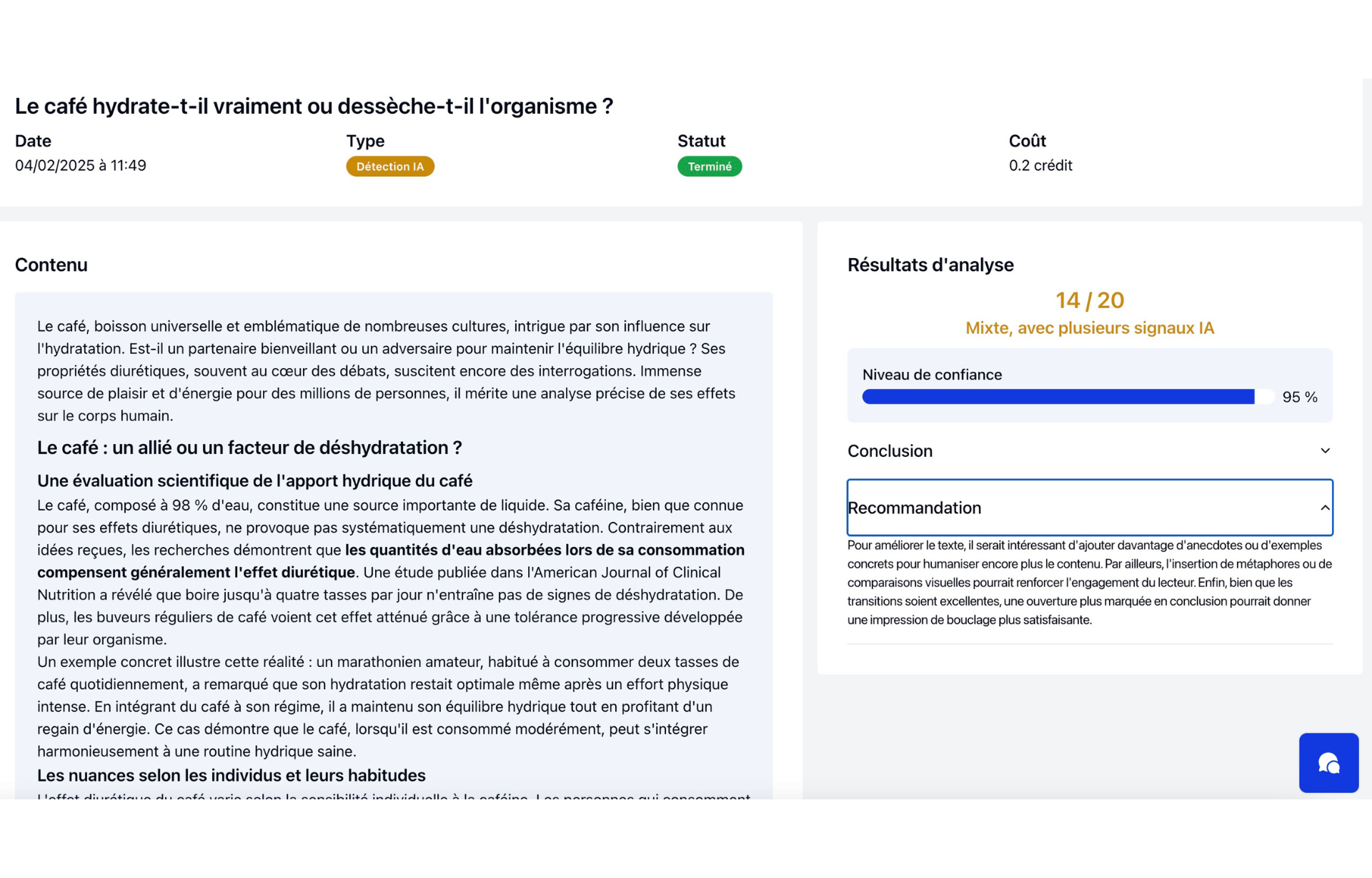

Les détecteurs ChatGPT incluent des outils tels qu’Originality.ai et GPTZero. Chacun se distingue par son efficacité dans des contextes spécifiques. Originality.ai offre une interface rapide et intuitive, adaptée aux longues analyses. GPTZero, quant à lui, excelle dans les contenus académiques grâce à ses algorithmes précis.

Ces outils permettent aux utilisateurs de valider des textes variés, qu’il s’agisse de rapports professionnels ou d’articles journalistiques. Cependant, leurs performances diffèrent selon les besoins. Originality.ai analyse rapidement des documents volumineux, tandis que GPTZero se spécialise dans l’étude des schémas complexes.

Les défis rencontrés par ces outils

Malgré leur efficacité, ces détecteurs ne sont pas infaillibles. Les faux positifs restent une problématique, surtout face aux contenus hybrides, mêlant IA et humain. Certains articles journalistiques ou académiques, bien qu’authentiques, subissent des interprétations erronées.

Une double vérification manuelle est souvent recommandée pour confirmer les résultats. Ces limites renforcent l’importance d’utiliser ces outils comme support, et non comme unique arbitre. Une interprétation nuancée garantit une meilleure compréhension des données analysées.

Les applications pratiques des détecteurs ChatGPT dans différents domaines

Un impact dans l’éducation et les entreprises

Les détecteurs ChatGPT jouent un rôle majeur dans la validation des travaux académiques. Leur utilisation garantit l’authenticité des devoirs et rapports remis par les étudiants. Les enseignants, souvent confrontés à des suspicions, utilisent ces outils pour maintenir un niveau de transparence élevé.

Dans le secteur des entreprises, ces détecteurs apportent une valeur ajoutée essentielle. Une agence marketing, par exemple, peut s’assurer que ses campagnes soient rédigées par des rédacteurs humains. Cette vérification améliore la qualité perçue de leurs projets, tout en évitant des malentendus coûteux.

Des implications éthiques et juridiques

L’utilisation des détecteurs soulève des questions éthiques importantes. Certains auteurs perçoivent ces outils comme une intrusion dans leur processus créatif. La crainte d’être analysé modifie leur approche stylistique, réduisant parfois leur spontanéité.

Les implications juridiques ne doivent pas être sous-estimées. L’analyse de contenus personnels, sans consentement explicite, pourrait enfreindre des lois sur la vie privée. Ces préoccupations nécessitent une réflexion approfondie pour équilibrer innovation et respect des droits individuels.

Les limites et perspectives d’évolution des détecteurs de texte IA

Des contenus hybrides toujours difficiles à analyser

Les textes combinant des contributions humaines et générées par IA posent des défis complexes aux détecteurs. Ces contenus, souvent indétectables, échappent aux analyses actuelles. Cette limite révèle la nécessité d’améliorer les algorithmes pour mieux comprendre cette nouvelle réalité.

Les biais culturels des algorithmes constituent une autre difficulté. Certains styles linguistiques, non conventionnels ou issus de cultures spécifiques, risquent d’être mal interprétés. Ces erreurs renforcent l’exigence d’une inclusion plus large dans le développement des outils.

Des technologies en constante évolution

Les innovations futures pourraient transformer ces détecteurs. Des algorithmes plus robustes offriront une meilleure analyse des textes hybrides. Ces avancées incluront des bases de données enrichies et un apprentissage continu pour s’adapter aux évolutions de l’IA.

Une collaboration internationale entre chercheurs et développeurs pourrait standardiser ces outils, renforçant leur interopérabilité. Ces efforts collectifs marqueraient un tournant décisif dans la détection des textes générés.

Les détecteurs ChatGPT, malgré leurs limites actuelles, annoncent une révolution dans l’analyse des contenus numériques. Leur évolution rapide promet des surprises fascinantes pour les années à venir !